Si l’intelligence artificielle promet de transformer le monde du travail, elle n’échappe pas aux inégalités qu’elle est censée dépasser. Quels biais sont à l’œuvre, dans l’appropriation des outils comme dans leur conception ? Et quelles conséquences, quels risques, quelles solutions pour les organisations ?

Quand l’appropriation de l’IA crée un nouveau terrain d’écart entre les genres

D’après une étude de 2025, l’usage de l’IA est 25 % plus faible chez les femmes que chez les hommes[1]. Cette analyse menée par les universités de Berkeley, Harvard et Stanford fait la synthèse de 18 travaux représentant un échantillon de plus de 140 000 personnes (chefs d’entreprise, data analystes, développeurs, cadres, etc.) issues de plusieurs pays à l’instar de la Chine, du Kenya, du Maroc, du Mexique ou encore des États-Unis. Toutes géographies confondues, les femmes sont plus réticentes à utiliser l’IA. Et la question de l’accès aux outils ne suffit pas à elle seule à justifier ces écarts. En effet, l’étude révèle que même lorsque les possibilités d’utilisation sont les mêmes, les femmes demeurent globalement moins enclines à mobiliser l’intelligence artificielle. Ces résultats interrogent directement la promesse d’une technologie supposée neutre et universelle, et posent une question centrale : l’IA est-elle en train de devenir un nouveau vecteur d’inégalités de genre ?

Comment expliquer ces disparités d’utilisation ? Les auteurs mettent en lumière plusieurs mécanismes à l’œuvre. Tout d’abord, des écarts d’exposition et d’acculturation aux technologies d’intelligence artificielle. À niveau d’éducation et de profession équivalents, les femmes déclarent moins bien connaître les capacités concrètes de l’IA générative et moins savoir comment l’utiliser dans des cas d’usage professionnels précis, tels que l’automatisation de tâches répétitives, l’aide à la rédaction de contenus (courriels, rapports, notes de synthèse), l’analyse et la visualisation de données, ou encore le soutien à la prise de décision. Il s’agit du facteur déterminant le plus important identifié par les auteurs. De plus, les femmes ont moins confiance en leurs capacités à utiliser l’IA générative. En effet, ces dernières ont davantage tendance à sous-estimer leurs compétences ou à craindre de « mal utiliser » l’outil, là où les hommes se montrent plus enclins à expérimenter.

Un autre point est central dans la compréhension de ces disparités : les normes culturelles et professionnelles. « Les femmes sont davantage pénalisées lorsqu’elles sont jugées comme n’ayant pas d’expertise dans différents domaines. (…) Elles pourraient craindre que quelqu’un pense que, même si elles ont trouvé la bonne réponse, elles ont “ triché” en utilisant ChatGPT » précise Rembrand Koning, l’un des auteurs de l’étude et professeur à la Harvard Business School. Ces résultats mettent en évidence trois leviers majeurs : l’exposition différenciée aux technologies, les écarts de confiance dans leur utilisation et le poids des normes sociales qui renforcent le sentiment d’illégitimité. Si les normes culturelles et sociales influencent la manière dont nous utilisons l’intelligence artificielle, il convient également d’interroger la façon dont ces mêmes normes et biais façonnent les outils eux-mêmes.

Derrière l’algorithme : quand l’IA reproduit et accentue les stéréotypes de genre

Le sujet de l’adoption genrée de l’IA soulève sur une autre problématique : les modèles reproduisent et amplifient les biais existants

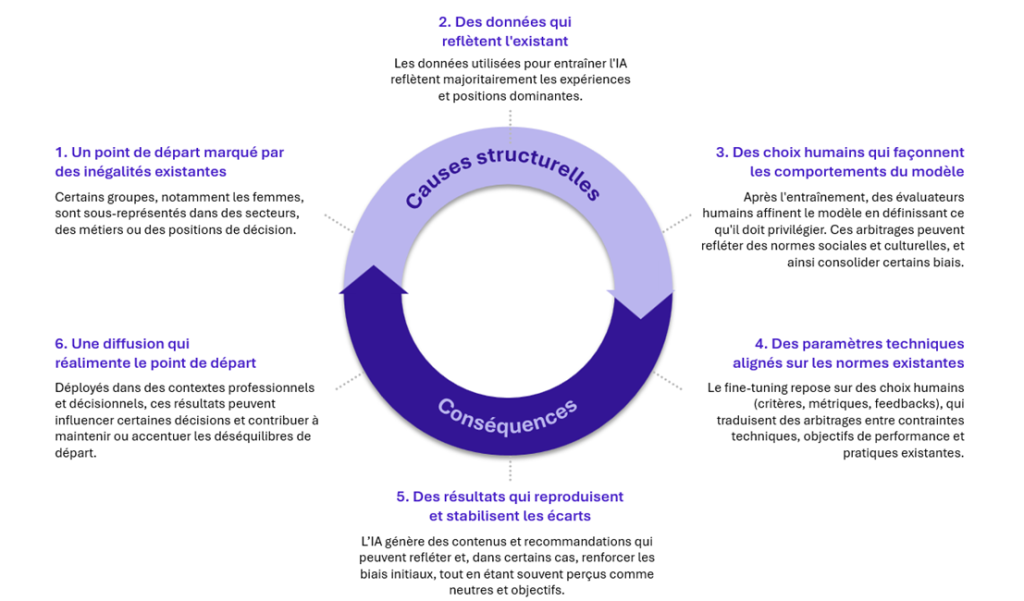

Afin de comprendre ce mécanisme, il convient de se pencher sur la manière dont ces modèles fonctionnent. Première chose à souligner, l’intelligence artificielle ne génère pas de biais ex nihilo. En effet, les modèles sont entraînés sur des corpus massifs (livres, articles, contenus en ligne) qui reflètent les inégalités et stéréotypes existants. Cette phase d’apprentissage est ensuite complétée par une étape de fine-tuning (ajustement) : des évaluateurs humains notent les réponses du modèle pour l’orienter vers les plus pertinentes. Mais ces jugements sont eux-mêmes socialement situés. À chaque étape (choix des données, critères de pertinence, définition de la « bonne réponse »), des biais peuvent s’introduire.

À cela s’ajoute un facteur structurel majeur : la sous-représentation des femmes dans les équipes qui conçoivent ces technologies. Selon les différents rapports, les femmes occupent entre 25 et 30 % des postes dans le secteur de l’IA. L’absence de diversité limite non seulement la détection des biais, mais constitue également un biais structurel où les technologies sont conçues de manière à reproduire certains stéréotypes.

Quels impacts ?

Les écarts d’adoption de l’IA entre les femmes et les hommes impliquent de nombreuses conséquences, tant à l’échelle individuelle que collective. A titre individuel, une moindre appropriation de l’IA peut priver les femmes de compétences désormais stratégiques. Cette situation pourrait contribuer à creuser davantage les écarts existants en termes de rémunération et d’opportunités de carrière, et entraîner une perte de compétitivité des femmes face à leurs homologues masculins.

À l’échelle collective, celle des organisations, traiter ce sujet comme un enjeu purement éthique revient à sous-estimer un risque opérationnel réel. Avec 29 % des emplois à dominante féminine exposés à l’automatisation liée à l’IA[2], un déficit d’appropriation des outils par ces populations crée un double enjeu pour l’entreprise : prévenir le décrochage d’une partie des effectifs et contenir les pertes de productivité. De plus, la sous-représentation des femmes parmi les utilisateurs de l’IA contribue également à un appauvrissement des données et des interactions qui alimentent ces modèles, renforçant potentiellement les biais existants.

Ces risques opérationnels s’accompagnent d’enjeux de conformité et de réputation tout aussi importants. Le risque de conformité est le plus immédiat. L’AI Act impose des obligations strictes pour les systèmes d’IA à haut risque utilisés dans le recrutement, l’évaluation des performances ou l’accès au crédit : les entreprises doivent documenter leurs modèles et démontrer que des mécanismes de détection et de mitigation des biais ont été intégrés dès la conception. Le risque réputationnel demeure, quant à lui, souvent sous-estimé. Dans un environnement où l’attractivité employeur intègre désormais les enjeux d’équité numérique, une entreprise qui ne structure pas sa démarche sur l’IA s’expose à une dissonance croissante.

Quelles solutions ?

La réponse est culturelle et organisationnelle, et elle suppose d’agir sur quatre leviers complémentaires.

- Affiner la connaissance et la data

Tout plan d’action commence par la mesure. Sans données sur qui utilise l’IA, à quelle fréquence et pour quels cas d’usage, ventilées par genre, impossible d’identifier les écarts réels ni de construire des réponses adaptées.

- Proposer des formations ancrées dans une vision plus globale

Le facteur le plus déterminant n’est pas l’accès aux outils, mais le manque de confiance dans ses propres usages et la méconnaissance de leurs capacités concrètes. Cela appelle des formations ancrées dans les cas d’usage métier réels, pensées pour les profils qui sont les plus éloignés de l’IA et articulées à une démarche plus large de lutte contre les disparités au sein de l’entreprise. Toutefois, sans signal organisationnel clair, l’usage de l’IA reste ambigu, valorisé dans certains périmètres et suspect dans d’autres, et les réticences persistent. Par ailleurs, si les expérimentations se concentrent sur des périmètres à dominante masculine (tech, finance, stratégie…), l’écart d’exposition se reconstitue mécaniquement. Les cas d’usage IA doivent aussi toucher les métiers à dominante féminine (RH, communication, fonctions support), qui sont précisément les plus exposés à l’automatisation.

- Viser la représentativité de genre dans les équipes data et IA

La même logique s’applique à la composition des équipes data et IA en interne : une équipe homogène produit des outils calibrés pour une partie seulement des usages. Intégrer la diversité dès la conception des solutions IA internes est aussi une condition de leur pertinence.

- Mettre en place des mécanismes de contrôle

Le risque de conformité est le plus immédiat. L’AI Act impose des obligations strictes pour les systèmes d’IA à haut risque utilisés dans le recrutement, l’évaluation des performances ou l’accès au crédit : les entreprises doivent documenter leurs modèles et démontrer que des mécanismes de détection et de mitigation des biais ont été intégrés dès la conception.

Le gender gap dans l’adoption de l’IA n’est pas une fatalité, c’est un risque pilotable, à condition de le traiter comme tel. Les entreprises qui anticipent évitent de transformer cet écart en désavantage structurel durable. Dans la course à la maîtrise de l’IA, l’inaction est déjà une perte de position.

Sources :

[1] Global Evidence on Gender Gaps and Generative AI – Working Paper – Faculty & Research – Harvard Business School

[2] Gen AI, occupational segregation and gender equality in the world of work | International Labour Organization